|

5 M% M, `2 D- |9 }/ C, O r; g

原标题:汇总教程 | 视觉/激光/多传感器融合SLAM,三维重建,运动规划,从入门到进阶!

9 o! Z0 g8 }( C5 V& v4 l( ]/ E: P6 Q+ l% ?

计算机视觉life”,选择“星标”

5 X3 k' O. z- Z1 D 快速获得最新干货 3 f, k4 u) L' F: x+ Z4 S

背景介绍 & Z9 |4 |; V/ k6 _6 W6 R

这两年 自动驾驶领域非常火热,发生了一轮又一轮的融资, 图森未来在美股上市,被称为“全球自动驾驶第一股”。 大疆创新正式推出旗下智能驾驶业务品牌“大疆车载”,华为、小米也纷纷下场。近日,自动驾驶干线物流企业千挂科技完成2亿元Pre-A轮融资,MINIEYE完成D轮累计8亿融资。。。 8 K( F$ y7 M$ |6 z, Y, D2 H0 P9 `

在 增强现实(AR)领域, Facebook已经从社交网络公司改名为元宇宙公司Meta,字节跳动重金收购AR/VR头显公司Pico,腾讯、阿里也纷纷入场,连罗永浩也告别了社交平台,将在AR领域再次创业,不知道是AR领域的明灯还是Ming灯。。。 ( L, v! v& {0 Z' [2 C

在 机器人领域, 扫地机器人公司 石头科技上市, 物流机器人极智嘉在筹备IPO, 清洁机器人公司 高仙完成B+轮1亿美元融资。。。 . J& K: i$ i4 W

在自动驾驶、无人机、增强现实、机器人导航等领域的技术栈中,即时 定位和建图(SLAM)是其中的核心技术之一。 SLAM中所涉及到的传感器有 相机、激光雷达、IMU、GPS、轮速计等,面对不同的平台和传感器配置,如何选择适合自己的技术方案呢? 0 }5 C# A" P. F- T$ X9 K

视觉SLAM基础

, R: R1 Y/ v% q9 O* J- r ORB-SLAM2是业内最知名、应用最广泛的视觉SLAM开源代码之一。它有如下优点:

' o* E2 e- S' @/ c0 N" s

& n0 ?2 I8 e5 T0 b% N: D! b 支持 单目,双目和RGB-D相机的完整开源SLAM方案,能够实现 地图重用、回环检测和重新定位的功能。 * {7 m: i; l% v( _# V% _9 Q

支持轻量级定位模式,可以达到零漂移,此时不使用局部建图和回环检测的线程,可以用视觉里程计来跟踪未建图区域。 4 x+ y6 u2 u. b2 i8 J: u1 Q+ w

采用ORB特征,具有旋转不变性、光照不变性、尺度不变性,匹配速度快,适合实时应用。无论是在 室内的小型手持设备,还是到 工厂环境的无人机和城市里驾驶的汽车,ORB-SLAM2都能够在CPU上进行实时工作。 2 @' j( u) g! w

跟踪、局部地图、闭环、重定位等所有的任务都采用相同的ORB特征,使得系统内数据交互更高效、稳定可靠。

; q) L- Z* |6 \2 h- N1 f; C# D 单目初始化和应用场景解耦,不管是平面还是非平面场景,都可以自动 初始化,无需人工干预。

% `' z; A& H" O" c1 g 地图点和关键帧创建比较宽松,但后续会进行严格筛选,剔除冗余关键帧和误差大的地图点,增加建图过程的弹性,在 大旋转、快速运动、纹理不足等恶劣情况下可以提高跟踪的鲁棒性。 2 Y2 F n7 f$ W4 _$ X) n9 z0 Q2 L2 N

采用共视图,使得跟踪和建图控制在局部共视区域,与全局地图大小无关,可以 在大场景下运行。 0 H/ w* F4 M9 m$ F% E0 }* z

使用本质图(Essential Graph)来优化位姿实现回环检测,耗时少精度高 。 0 T8 `$ e; O+ A2 T0 f5 _9 x* d3 U

相比于直接法,可以用于宽基线特征匹配,更适合于 对深度精度要求较高的场景,比如三维重建。

3 c2 \2 I3 L1 B; C 定位精度高,可达厘米级,是特征点法SLAM的经典代表作品。

- Q0 ?/ a0 [7 S' [/ P+ R+ ] 代码可读性强,包含很多工程化技巧,非常实用。

4 U: U: Q p1 j7 x: l' q1 _

* [: o( v% I8 z3 ~ ORB-SLAM2 用于室内三维重建 ; V$ \' Q) k2 m$ q& ?' Q" \0 M

ORB-SLAM2详细注释的代码持续更新,网址: B1 [/ v! z7 a, u( \1 A3 V

https://github.com/electech6/ORB_SLAM2_detailed_comments

. }* i& L1 d* L' X1 g" h 视觉惯性SLAM技术

2 b7 c S9 Z. p% Y% s$ `% S ORB-SLAM3是在ORB-SLAM2的基础上开发的视觉惯性SLAM技术,于2020年7月发布。它在定位精度和效果上几乎碾压了同类的开源算法,受到极大关注。

0 L2 r& U, i8 p7 y 它有如下特点: " V- \' L; B4 W2 Q6 w

1、 第一个可以运行视觉、视觉惯性和多地图,支持单目、双目和RGB-D相机,且支持针孔和鱼眼镜头模型的SLAM系统。

' `; x* U) Z r7 @- S; | 2、该算法可以在不同大小,室内和室外环境中鲁棒、实时的运行,精度上相比于以前的方法提升了2~5倍。 L' C& L5 Y6 A! u. H: g0 L

3、 多地图系统可以让系统在视觉信息缺乏的场景下长时间运行。比如当跟踪丢失的时候,它会重新建立新的地图,并在重新访问之前的地图时,无缝地与之前的地图合并。

5 \" N R9 e$ f) D9 _9 J) V- a' z: R7 o 4、实验结果证明,双目惯性模式下,该算法在无人机数据集EuRoC上可以达到平均3.6cm的定位精度,在手持设备快速移动的室内数据集TUM-VI上达到了9mm的定位精度。

: q" c+ ^6 J0 P$ G4 s$ m 从室内到室外,丝滑闭环 6 n: d: Y; l. P& o4 `

全网最详细ORB-SLAM3代码注释地址: ' X" h5 ~5 T! A6 S

https://github.com/electech6/ORB_SLAM3_detailed_comments

8 X( S) K1 V" k- ]4 X+ x& z$ [# t VINS-Mono/Fusion 系统教程

" V2 n3 A. M6 s' X- Z- g" x# {' ` VINS即Visual-Inertial navigation Systems,是视觉惯性导航系统的统称,不过我们平时所说的一般是指VINS-Mono/Fusion。 香港科技大学飞行机器人实验室(沈邵劼团队)在2018年开源了VINS-Mono算法。第一作者秦通(2019华为天才少年),该论文获2018年机器人顶级期刊IEEE Transactions on Robotics最佳论文奖。它用一个单目相机+惯性测量单元(Inertial Measurement Unit,简称IMU)实现了紧耦合的视觉和惯性联合状态估计,在保证高精度里程计效果的同时,还可以同时估计出传感器外参,IMU零偏以及传感器时延。2019年该团队开源了VINS-Mono的升级版VINS-Fusion,它支持多种视觉惯性传感器类型,包括单目+IMU,双目+IMU,以及纯双目。VINS-Mono和VINS-Fusion在当年一骑绝尘, 是非常经典且优秀的VIO框架。

7 L0 j# H' z9 \' r' d& E. ^ 以下是VINS-Fusion在汽车SLAM上的效果:

) |2 X7 R& y3 H0 w n R9 n 以下是讲师详细注释的 代码地址:

) g# H a5 y' [" L/ ` https://github.com/xieqi1/VINS-Mono-noted

4 E* T3 N8 c# I* B https://github.com/xieqi1/VINS-Fusion-noted % ^# ^& y+ P8 Z

基于LiDAR的多传感器融合技术 5 ]5 `/ O* |3 Q& L, M: y( y% d* F

多传感器融合SLAM是自动驾驶、智能机器人中的核心技术。 目前工业界用的主流多传感器融合SLAM框架包括LOAM/A-LOAM、LeGO-LOAM、LIO-SAM等。 * u- X7 r+ l6 W% @* V! K! y

* N/ B8 A& P1 l$ T5 r" N5 R9 S8 k

LOAM是Ji Zhang早期开源的多线LiDAR SLAM算法。该代码可读性很差,作者后来将其闭源。

) A% o* Z0 Q. h# q( ^! K A-LOAM是港科大秦通博士(VINS-Mono一作)在LOAM原有代码基础上,使用Ceres-solver和Eigen库对其进行重构和优化,在保持原有算法原理的基础上,使其可读性大大增加,作为入门多线激光slam最好选择。 ; O: G: L- }& n1 U

LeGO-LOAM 是Tixiao Shan在原有LOAM基础上,做了一些改进包括:1、对前端里程计的前量化改造,提取地面点更适配水平安装的LiDAR; 2、使用SLAM中的Keyframe概念以及回环检测位姿图优化的方式对后端进行重构。 2 t( k, w0 m9 G. t

& t& D3 T+ N% I4 l/ q3 P0 e

' x: G) |0 y% }1 F/ C: V

LIO-SAM 是Tixiao Shan在LeGO-LOAM的扩展,添加了IMU预积分因子和GPS因子:前端使用紧耦合的IMU融合方式,替代原有的帧间里程计,使得前端更轻量;后端沿用LeGO-LOAM,在此基础上融入了GPS观测。同时前端后端相互耦合,提高系统精度。

) @$ {9 n+ H, ~' S8 i$ [6 W* v" V/ n' H" F }

LIO-SAM 的效果 3 d# ~3 K: G! |. E2 P/ E

/ \; R; W: F9 t7 }3 q

LVI-SAM是Tixiao Shan 2021年最新的开源工作,他将LIO-SAM和VINS-Mono进行了结合,是一个通过平滑和建图实现激光雷达-视觉-惯性里程计的紧耦合框架,由两个紧耦合子系统组成:一个视觉惯性系统VIS和一个激光雷达惯性系统LIS。当两个子系统中的一个发生故障时,系统也可以发挥作用,这增加了它在无纹理和无特征环境中的鲁棒性 3 A5 k& `' Q& x) j2 V% q7 ~

2 [, g" t2 ~7 M& g0 ^) X% L- n 独家注释代码

9 o/ P7 U: e$ q( ], z https://github.com/xieqi1/a-loam-noted 1 J5 [3 H, N8 [; _. t" O7 ?0 R: p

https://github.com/xieqi1/lio-sam-noted

1 u- g4 b8 e y0 g& e https://github.com/electech6/LVI-SAM_detailed_comments

! t2 i9 U& L# {8 a- `( V 激光SLAM技术 " V( q, D# B. w, j

Cartographer是Google推出的一套基于图优化的激光SLAM算法,它同时支持2D和3D激光SLAM,可以跨平台使用,支持Laser、IMU、Odemetry、GPS等多种传感器配置。该算法可以实现实时定位和建图。 - h; Z% _9 O6 X' L, |, k# l

Cartographer建图过程

7 W' G3 w/ F5 k+ U! V! |+ I Cartographer建立的栅格地图可以达到5cm的精度,该算法广泛应用于服务机器人、扫地机器人、仓储机器人、自动驾驶等领域,是最优秀的激光SLAM框架之一。 + x6 R7 B) A3 W

Cartographer做了超详细源码注释

2 k6 s) V8 V) i https://github.com/xiangli0608/cartographer_detailed_comments_ws " v8 m( a4 Q& L1 f

机器人运动规划 * p K; @, H; E6 M h( G

运动规划和SLAM什么关系?

% v7 b4 b) E6 ~# B 其实在企业里,SLAM算法工程师、运动规划工程师通常是 相对独立的岗位,SLAM技术通常可以得到稀疏的定位地图,结合后处理可以得到稠密的三维点云地图。此时我们需要用一定的规则将其转化为 栅格化地图,机器人在这个 地图的基础上进行运动规划(导航)。SLAM和运动规划是自主机器人的两个核心技术。

% d1 i4 u) ?3 n/ u g 简单来说,解决机器人导航问题一般被称为运动规划,就是让机器人可以自主根据传感器获取外部环境信息,在当前环境中找到一条适合机器人行走的最佳路径。这不是一个简单的工作,因为地图可能发生变化,其他运动的物体也是必须要绕过的障碍物,所以常常需要更改自己的规划,如何在这种复杂的环境下高效率地实现最佳路径,就是运动规划的使命。 t/ j1 p5 w% r. s* o' ?

运动规划在移动机器人的应用

/ t8 | ?' H" i, ^9 j { 独家注释代码

/ }, Z: W& h5 D' f https://github.com/felderstehost/ros-navigation-noetic 2 B2 {! g( r8 f; i- q# G

视觉几何三维重建技术

, ?! k: g5 A0 d6 w3 {+ ]

, V9 ? W `# e 三维重建是指用相机拍摄真实世界的物体、场景,并通过计算机视觉技术进行处理,从而得到物体的三维模型。英文术语:3D Reconstruction。 ; k- S, ]8 _$ T/ i& s5 D7 ?

涉及的主要技术有:多视图立体几何、深度图估计、点云处理、网格重建和优化、纹理贴图、马尔科夫随机场、图割等。

1 g( N' N% K0 Y, M. d 是增强现实(AR)、混合现实(MR)、机器人导航、自动驾驶等领域的核心技术之一。 三维重建结果6 ?) g' [2 n0 X f& I2 N! }

1 Z: z! `8 x* M- `

全网最详细的代码注释地址:

* V8 F) s$ [/ U; N# P8 c/ W) `1 H https://github.com/electech6/openMVS_comments % V l0 T- M. h2 M/ i0 A

深度学习三维重建技术框架

/ _+ D! r& `+ p- E. ` 传统的重建方法是使用光度一致性等来计算稠密的三维信息。虽然这些方法在理想的Lambertian场景下,精度已经很高。但也有一些常见的局限性,例如 弱纹理,高反光和重复纹理等,使得 重建困难或重建的结果不完整。因此,传统三维重建方法在重建的完整性等方面仍有很大的改进空间。

( K7 E0 J6 E+ s# {6 Z# w" T 近年来深度学习在三维重建上取得了很大的成功。基于学习的方法可以引入比如 镜面先验和反射先验等全局语义信息,使匹配更加鲁棒,从而解决传统方法无法克服的难题。因此掌握基于深度学习的三维重建前沿算法非常重要。另外,在这个大数据时代,深度学习已经是大家必须掌握的技能,传统视觉算法已经很难有新的突破,各个领域都在朝深度学习方向研究,近几年各大视觉会议论文都是基于深度学习来实现三维重建,各个大厂招聘也越来越看重深度学习三维重建方法。 ! l1 e, N. I. {

C++编程入门到进阶 " U3 k: ?' t3 y: M2 R

很多初学SLAM的小伙伴都有个疑问:号称宇宙第一语言的Python,简单好用,包又多,功能又强大,为啥SLAM算法里很少使用呢? " |& v& q1 ]8 A, ~7 m- B

SLAM知识星球嘉宾刘国庆在知乎做了回答 8 v' z! v: w( Y' Y3 Q4 g5 J3 Y

这里再补充几点: 9 T" [0 L: l5 ^! n q

, F6 r* x) B0 U4 F+ {

C++具有 极高的性能和运行效率,很多语言都是在C/C++基础上封装的,比如Python。就这一点足以秒杀众多的高级语言。 $ q7 i9 V) V6 o5 [3 ?- y& o

C++发展了三十多年一直是编程常青树,一直使用,一直在发展,C++岗位需求会 越来越旺盛,只增不减。 * F; Q2 Q! i u5 p

C++能够 操控底层,非常适合 和硬件打交道。 $ {4 n* }* l/ J4 ^9 Z

& o, A7 n; v. V$ u

很多小伙伴都是机械、自动化、通信等非计算机专业,也没有经历过系统的C++训练,而在具体的项目中,比如SLAM算法框架中,通常的代码并不是我们在书上看到的那样简单直白。很多同学在学习SLAM的过程中感觉C++是一座难以跨越的大山, 学习过程漫长而痛苦,项目开发遇到bug也不会调试,书看完了代码还是不会写,代码一改就错,一错就懵。 - h! n* M; ?% @2 c+ S

相机标定技术框架

3 m' o* }8 f/ j. L, m# ?3 \& L5 g9 ~; V* T; Q' _$ ?/ _" J/ ?

相机标定是指借助专用的标志物(如棋盘格)来估计相机的图像传感器参数(内参、外参)和镜头参数(畸变系数)。

7 |* i1 \/ ~; y! i 它是一种计算相机二维图像和三维世界相对映射关系的一种方法。标定相机过程涉及相机成像模型、多视图几何、非线性优化等知识。

& \1 {# }4 B) Y- s 相机标定是三维视觉的基础。

( [. @$ ~/ w0 W d. r" Z/ Q( @: v# o

% P1 S' b4 v. E3 p 毫不夸张的说, 相机标定是一切三维视觉的基础。它广泛应用于 双目视觉、手眼机械臂、机器人定位建图、图像拼接、三维重建等场景。

8 T8 t. l$ V v/ E/ |. c8 [5 t' ` 全国最大的SLAM开发者社区

# a7 e" ~* Y4 _9 A3 Q* | SLAM社区:一个人啃SLAM,难受到自闭,硬顶还是放弃? " t9 D7 B7 ^1 V8 i3 S

在我们的SLAM和3D视觉知识星球里,很多刚入门的同学问的最多的问题我总结了一下,主要有: + N) l2 d: l5 c

2 l! w- k4 ^: A# L0 h& B 机械/自动化/数学等非计算机专业能否转SLAM?5 ]6 F. @, I6 Z$ K- k

导师不懂,但要我做SLAM方向,怎么入门?

# i! q; R% G) L0 z( Z7 h: ]) x( b# O$ c 编程基础差,数学不好,能否学习SLAM?

7 u3 N t" X* q6 ? 看完十四讲,下面怎么学习?% D- Z) E. l* l0 h) U

需要学哪些开源框架?怎么学习呢?

/ m) A( g+ P$ I" j6 C" i \ 编译遇到很多问题,怎么解决?

( u# z& \" B, Z 只有自己一个人学SLAM,没人讨论好痛苦,怎么办?% z: e4 L O; f' |7 c9 d& W7 b

想要和小伙伴组队系统的学习,有资源吗?& D- V) x2 a9 O9 {0 k! X( m

; ?" n2 O7 T1 |2 k( v

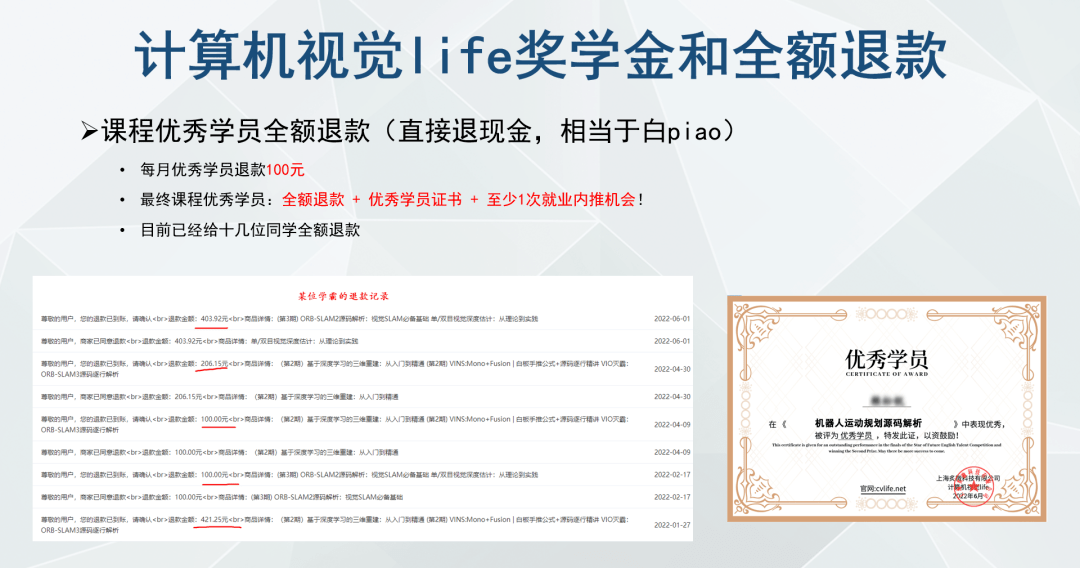

我们建立了全 国最棒的SLAM和三维视觉交流社区,包括 小白入门图文/视频教程、学习过程疑难点解答、每日最新论文/开源代码/数据集分享、在线学习小组、笔试面试题、实习/校招/社招岗位推荐、星主直播交流等。 # J! ?6 f, ^! a; {- P$ _ O7 V

" n* S* r. j* l) \( c

2018年创立、 3500+会员、 6100+主题分享、 9500+问答评论、 130+教学视频 - h# X: H* T+ `* L2 V) ?2 l$ c9 `. m+ J

教程:图文视频教程、涉及 代码调试/OpenCV/PCL/G2O/Ceres/视觉SLAM十四讲/LVISAM/R3LIVE

/ w3 x; C c l4 X5 H 资讯:每日论文分享、行业资讯汇总、每周汇总、精华汇总 6 h$ Y, W) v2 u9 F6 e* B2 o) [

直播:每月至少3次,涵盖学习经验/求职面试/实习历程/行业介绍 F6 T7 v3 b* i

活动:学习小组、行业资源对接、会员激励、有偿招募助教/兼职

. Q$ E; I; C9 \2 j7 R8 O8 o 求职:内推职位、SLAM面试题、笔试练习 & `3 k0 Z+ a2 o4 s7 x

…… 5 G0 k5 E; M( Y ~

5 z& m! m! {1 B" y% e k4 q

% Y* r: f4 l/ }; n

独家重磅课程官网:cvlife.net , b' C" z3 Q$ k1 [

1、SLAM社区: 一个人啃SLAM,难受到自闭,硬顶还是放弃? ( w6 E/ n) W1 q% [* O: w5 W3 |; @4 J

2、C++实战: 为啥SLAM代码都用C++不用Python? 1 Z/ V7 G0 L3 o- ?& I

3、多传感器融合SLAM 激光雷达-视觉-IMU多传感器融合方案!

$ ^* u# Y; b" S3 N u! z 4、VIO灭霸:VIO天花板ORB-SLAM3第2期上线!(单/双目/RGBD+鱼眼+IMU+多地图+闭环) ! }7 Y$ \+ \ Q$ `9 }0 X: E" c" T) U

5、视觉SLAM基础: 刚看完《视觉SLAM十四讲》,下一步该硬扛哪个SLAM框架 ? 8 L3 M: `, K# b) Y4 E4 B

6、机器人导航运动规划: 机器人核心技术运动规划:让机器人想去哪就去哪! 4 v6 i P- f% J& m- F

7、详解Cartographer: 谷歌开源的激光SLAM算法Cartographer为什么这么牛X? . J T; P, S/ Q$ l5 p$ f

8、深度学习三维重建 总共60讲全部上线!详解深度学习三维重建网络 $ Q# v0 S3 b/ J3 J" S" g

9、三维视觉基础 详解视觉深度估计算法(单/双目/RGB-D+特征匹配+极线矫正+代码实战)

+ \/ g3 R4 d+ d+ u$ ]5 ~6 w1 g 10、 VINS:Mono+Fusion SLAM面试官:看你简历上写精通VINS,麻烦现场手推一下预积分! % A( { A' x! ]1 z

11、图像三维重建课程:视觉几何三维重建教程(第2期):稠密重建,曲面重建,点云融合,纹理贴图 0 M, g r' d$ J. }

12、系统全面的相机标定课程:单目/鱼眼/双目/阵列 相机标定:原理与实战 返回搜狐,查看更多

1 }3 P P9 t3 h2 G; i( {# l% ]- `+ O6 W5 D

责任编辑: . z+ |3 q- K' Q

: c) u. _1 H3 V" t

8 g6 Z1 l$ O* G; Z; }6 K% d

8 S+ _3 U: ~7 P3 q% C

9 t: C1 y! n! N$ {# S2 X0 L% l |